Tecnología innovadora e investigación

Introducción

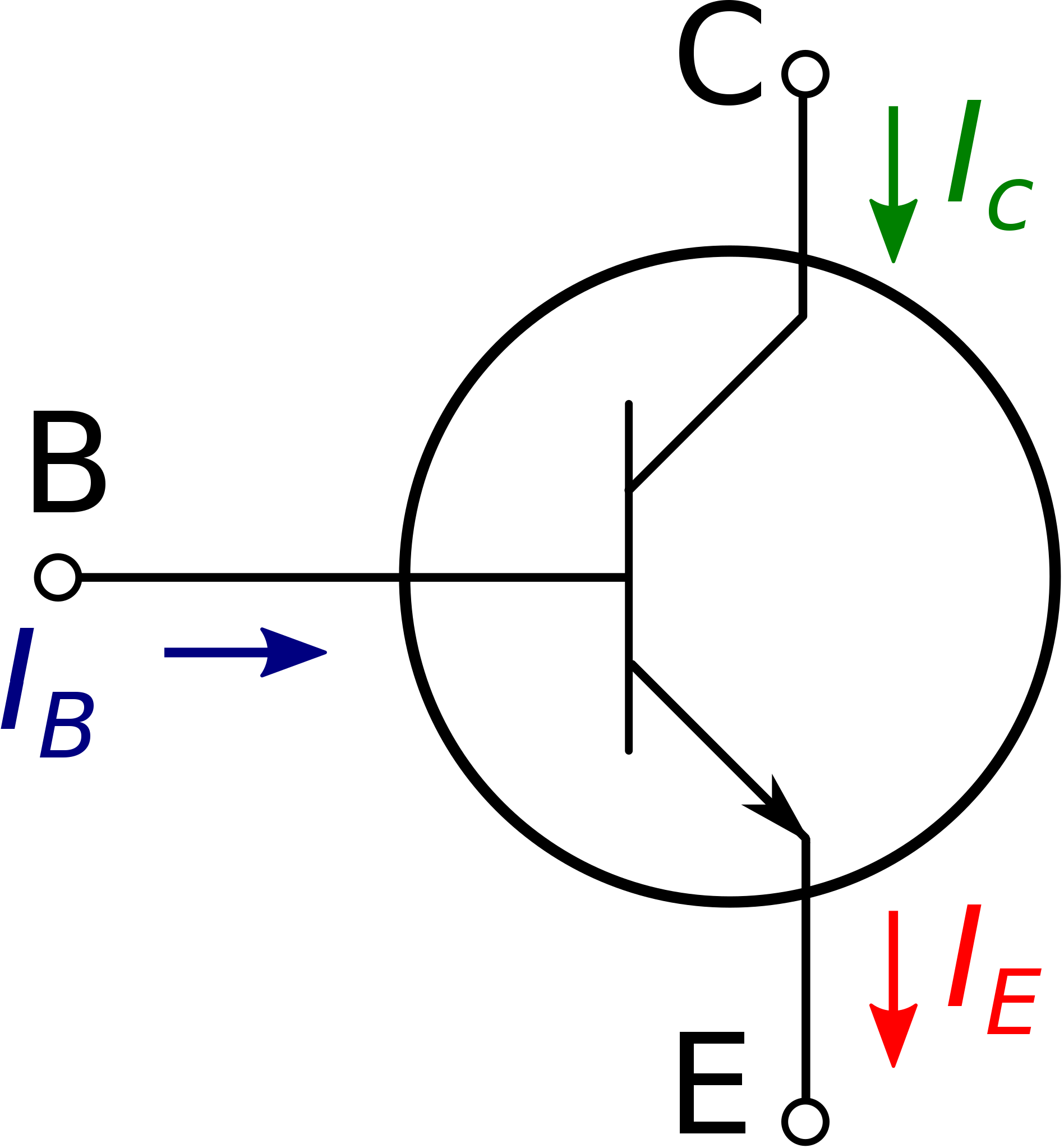

El elemento discreto más básico dentro de cualquier procesador o CPU es el transistor. Este dispositivo electrónico proporciona una señal de salida, en función de una señal de entrada. La presencia o ausencia de señal de salida conforma los 1 y 0 binarios resultantes.

Ley de Moore, llamada así por su creador Gordon Moore en 1965, propone que los transistores se duplican cada 2 años. Esta ley se ha ido cumpliendo durante 50 años, aunque cada vez el proceso de duplicación de los transistores es más lento, ya que hay un límite físico que hace que se venga sufriendo un estancamiento. Esto es perfectamente lógico, los transistores tienen unas dimensiones físicas que no se pueden reducir indefinidamente, cuando se llegue a dimensiones de unos pocos átomos, poco o nada más se podrá hacer.

El hecho de reducir el tamaño de los transistores y poder disponer de procesadores con una mayor densidad de transistores:

Baja el consumo del chip, y por ello se calienta menos.

Se pueden incrementar las frecuencias de trabajo, lo que permite a los transistores conmutar entre valores 0 y 1 mucho más rápidamente, aunque hay limitaciones físicas para la frecuencia.

Computación cuántica

Una vez asumidas las limitaciones de la ley de Moore, hay que estudiar qué alternativas existen que permitan continuar mejorando la potencia de computación.

La computación cuántica ofrece un potencial casi inimaginable.

Los computadores cuánticos se basan en la mecánica cuántica para alcanzar velocidades muy altas.

Algunos ejemplos de computadores cuánticos son: IBM Q System One, SpinQ Gemini, Intel Tangle Lake y Google Brislecone.

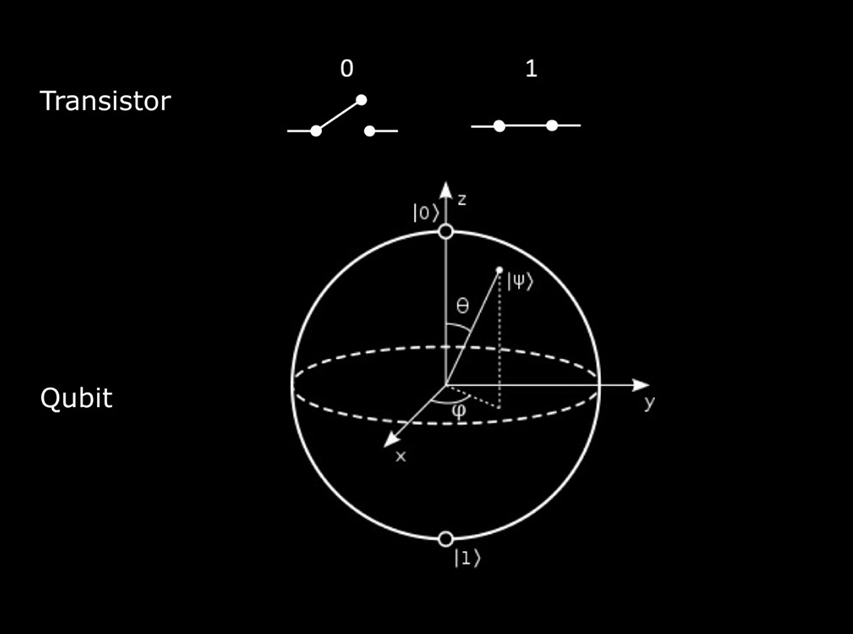

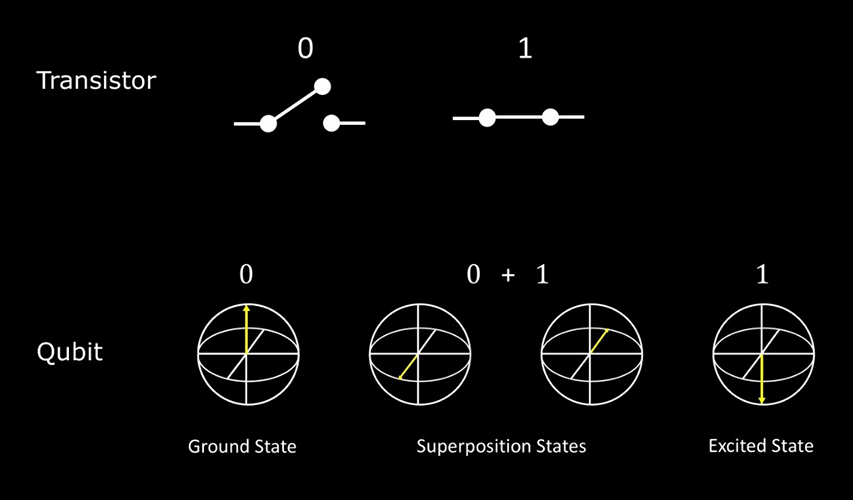

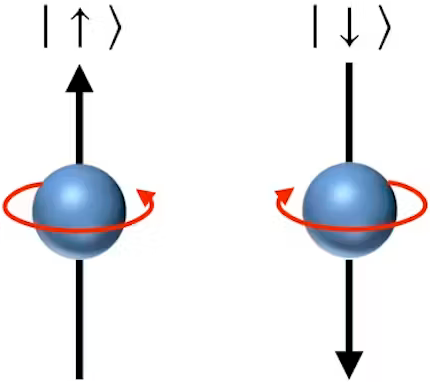

Como ya sabemos, los ordenadores convencionales manejan como unidad de información el bit, que pueden tener dos estados (1 o 0). En cambio, en un ordenador cuántico la unidad es el qubit, el cual, mediante el uso de dos principios de la mecánica cuántica, denominados superposición y entrelazamiento, puede realizar algunos tipos muy concretos de operaciones matemáticas, consiguiendo una capacidad mayor que todos los ordenadores de la actualidad juntos.

Principio de superposición

Gracias al principio de superposición, un qubit no solo puede estar en estado encendido o apagado a la vez, sino que también puede estar en un abanico enorme de estados intermedios.

Principio de entrelazamiento

Gracias al principio de entrelazamiento, los qubits pueden interactuar entre sí.

El entrelazamiento viene a decir que las propiedades de dos o más partículas se pueden vincular inextricablemente, incluso si se separan a grandes distancias. A groso modo, si tenemos dos partículas entrelazadas, una aquí y otra en Australia, si giramos una de ellas, la otra también lo hará.

Así, la verdadera potencia de la computación cuántica se tiene cuando se entrelazan varios qubits. Con tres qubits entrelazados, se pueden realizar 23 (8) cálculos simultáneos. Con 8 qubits, se podrían realizar 28 (256) cálculos simultáneos.

Esto significa que la potencia de procesamiento potencial de un computador cuántico se incrementa exponencialmente conforme se van añadiendo qubits.

El problema es que las superposiciones de qubits son realmente frágiles y efímeras. Cualquier tipo de interferencia magnética o de calor puede hacer que el sistema se colapse, produciendo errores en los cálculos.

Por ello, la construcción de un ordenador cuántico es muy compleja. Una de las formas de abordarlo es la computación cuántica basada en superconductividad.

Aplicaciones de la computación cuántica

Aún estamos lejos de disponer de sistemas que se puedan utilizar en sustitución de los actuales supercomputadores.

Existen numerosas aplicaciones previsibles para la computación cuántica, y entre ellas:

Machine learning (ML).

Simulaciones biomédicas / Síntesis de medicamentos.

Calentamiento global.

Entregas más rápidas (logística).

Proceso de investigación

La ciencia es el conjunto de conocimientos obtenidos mediante la observación y el razonamiento, sistemáticamente estructurados y de los que se deducen principios y leyes generales con capacidad predictiva y comprobables experimentalmente.

El método científico establece los pasos generales que nos permiten obtener conocimiento científico.

De forma muy básica, el método científico general podría resumirse en los siguientes pasos:

Observación: Observamos un aspecto de la realidad y recopilamos datos sobre el suceso.

Hipótesis: Con los datos recopilados planteamos una posible justificación o razón a dicho fenómeno.

Experimentación: Llevamos a cabo los experimentos oportunos para confirmar o refutar nuestra hipótesis.

Conclusión: Repetimos los pasos 2 y 3 de forma indeterminada hasta llegar a una conclusión. Las conclusiones se obtienen a partir de hipótesis confirmadas.

El método científico tiene que cumplir una serie de características:

Riguroso: pasos en orden.

Objetivo: hechos concretos y comprobables.

Progresivo: conocimientos acumulativos.

Racional: basado en la razón y la lógica.

Verificable: comprobable empíricamente.

Fases

La PREGUNTA

Algo absolutamente esencial en el método científico es LA PREGUNTA, pues lo absolutamente esencial es la pregunta que nos planteamos como marco de trabajo.

Búsqueda de información

Antes de iniciar cualquier investigación es imprescindible documentar el estado del arte, realizando una búsqueda y revisión de bibliografía.

Mediante este proceso obtenemos información sobre las ideas que se han aplicado al problema que queremos abarcar, documentándonos sobre lo que ha funcionado y lo que no, detalles de aplicación, buenas prácticas, etc.

Gestión bibliográfica

Se debe indicar la bibliografía utilizada.

La cita contendrá:

Autor/es.

Año de publicación.

Editorial.

Volumen.

Web.

DOI.

En el ámbito científico y técnico, estilos muy conocidos son los siguientes: UNE-ISO 690:2013, Chicago, Harvard, APA, IEEE...

Ética y legalidad en el ámbito científico

Uno de los fraudes más frecuente en el ámbito científico es el plagio, «copiar en lo sustancial obras ajenas, dándolas como propias». Por tanto, plagiar es usar las ideas o palabras ajenas sin un reconocimiento explícito de las fuentes.